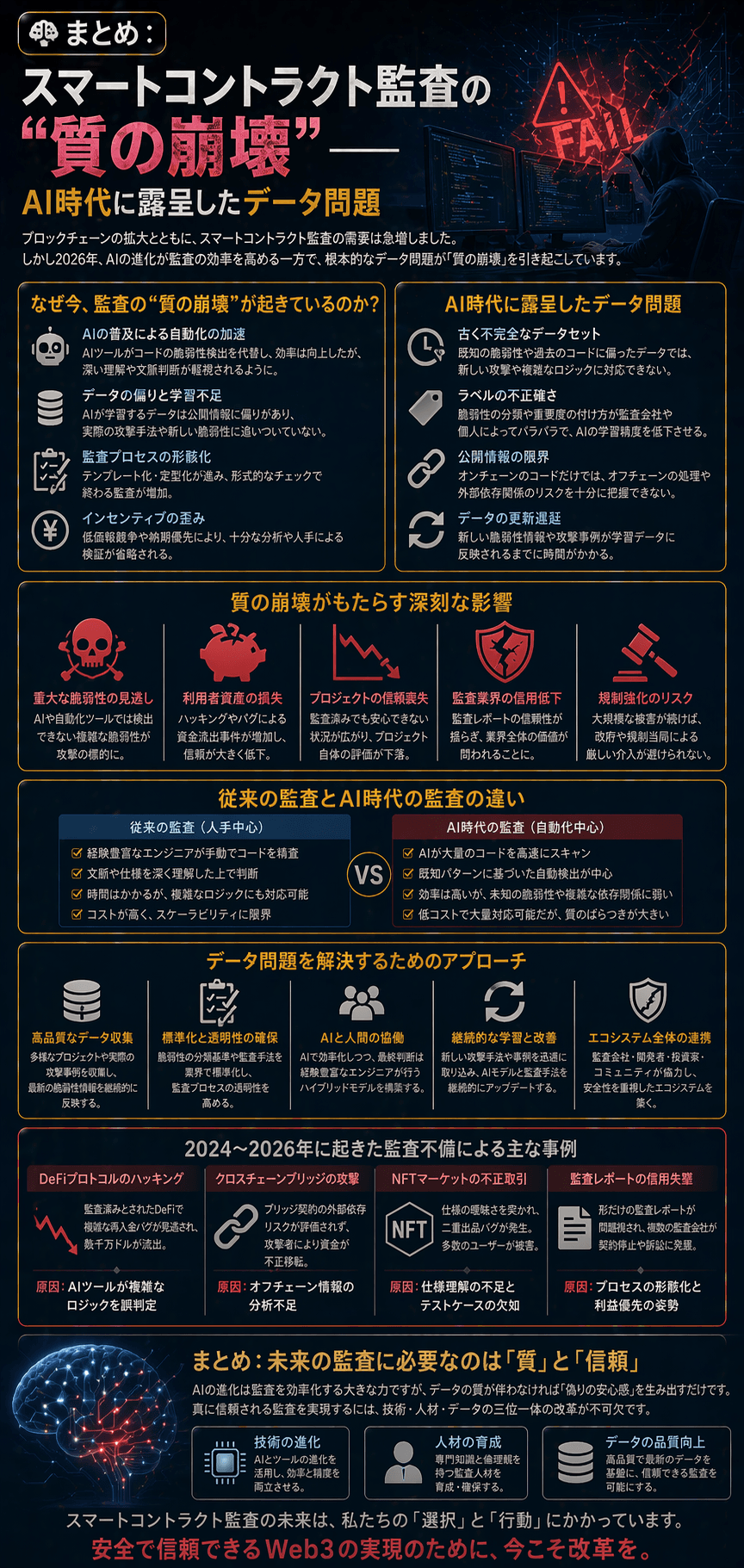

🧠まとめ:Web3、スマートコントラクト監査の質の崩壊──AI時代に露呈したデータ問題

これはかなり重要な示唆です。

一言でいうと👇

「Web3の監査データのほとんどは“AIにも人間にも役に立たない”」

📊 何が行われたのか?

投稿者(zaevlad)は:

- 2023〜2025年の監査レポートから

👉 23,000件以上の脆弱性データを分析

データソース:

- Code4rena

- Sherlock

- 監査企業・個人監査

さらに👇

- Informational(情報レベル)99%削除

- Low(低リスク)約40%削除

👉 “ちゃんと分析できるデータだけに精査”

⚙️ 評価方法(ここが本質)

各脆弱性を3軸でスコア化:

- 説明の深さ

- 修正方法の明確さ

- PoC(実証コード)の有無 ←最重要

補足:

- Solidityコードあり →加点

- 深刻度 →加点

最終スコア:

- 0〜15 → 正規化 → 0〜1

📉 結果:ほとんどが“低品質データ”

全体分布

- 平均:0.32

- 中央値:0.27

👉 半分以上が“かなり微妙”な品質

🧩 3つのクラスターに分裂

- 約0.05 → 一行だけ(ゴミに近い)

- 約0.25 → 説明あり(でも浅い)

- 約0.60 → 完全(PoC+修正あり)

👉 高品質は:

わずか25%のみ(ゴールデンデータ)

⚠️ 最も重要な発見

「Criticalの方が質が低い」

- Critical(致命的):0.33

- High(高):0.53

👉 逆転現象

なぜ起きる?

- Critical:

- 「やばい」だけで終わる

- 詳細書かない

- PoCなし

- High:

- ちゃんと説明される

- PoCあり

👉 結論:

“一番危険なバグほど説明が雑”

🧠 なぜこれがヤバいのか

① 修正できない

- 良いレポート:

- 数時間で修正可能

- 悪いレポート:

- 数週間放置 or 無視

② AIに学習できない

この研究の本来の目的👇

RAG(検索拡張生成)監査AIの構築

ここで問題:

- データが低品質 → AIも低品質

👉 つまり:

Web3はAI時代に不利な構造

🧭 構造的な問題まとめ

問題①:監査文化が雑

- 一行レポート大量

- PoCなし

- 再現不可

問題②:インセンティブの歪み

- 「見つける」ことが評価

- 「説明する」は軽視

問題③:AI時代に非最適

- RAGで使えない

- 学習データにならない

🔥 本質的な教訓

「脆弱性の“発見”より、“説明可能性”の方が価値が高い」

📌 まとめ

- 23,000件分析の結果:

- 75%は低品質

- 最重要ポイント:

- Criticalバグほど説明が雑

- AI視点:

- データ品質=モデル品質

- 結論:

Web3は“技術”ではなく“ドキュメント品質”で負けている